By extracting several topics from our news corpus, we gained a 10,000 feet view of corpus. We were able to outline many trends and events, but it took a bit of digging. This article will illustrate how the topics relate each to one another. We’ll even throw a bit of animation to take a look back the last 15 years.

When we extracted the topics from the corpus, we also found another way to describe all the news snippets and words. Instead of seeing a document as a collection of words, we could see it as a mixture of topics. We could also do the same thing with topics: every topics is a mixture of words used in its associated fragments.

Continue reading “15 Years of News – Analyzing CNN Transcripts: Visualizing Topics”

Category: Politics

15 Years of News – Analyzing CNN Transcripts: Topics

As we saw in the previous article, temporal analysis of individual keywords can be very interesting and uncover interesting trends, but it can be difficult to get an overview of a whole corpus. There’s just too much data.

One solution would be to group similar subjects together. This way, we could scale down a corpus of 500,000 keywords to a handful of topics. Of course, we’ll be losing some definition, but we’ll be gaining a 10,000 feet view of the corpus. In all cases, we can always refer to the individual keywords if we want to take a closer look. Continue reading “15 Years of News – Analyzing CNN Transcripts: Topics”

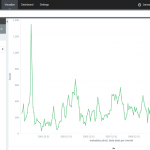

15 Years of News – Analyzing CNN Transcripts: Timelines

With 15 years of CNN transcripts loaded a database, I could now run queries to visualize the occurrences of words – like names – across time. Since I used a textual database name ElasticSearch, I could use Kibana to chart the keywords. Kibana is a good tool to build dashboards, but it’s not really suited to analyze extensively time series because it lacks an easy way to add several search terms on the same chart. Also, it doesn’t easily show percentages of occurrences in a corpus for a giving time period instead of absolute occurrences. This makes Kibana a good tool for a quick look at the data or to debug an issue with our transcript scrapper.

With this in mind, I used Amazon’s DynamoDB database, the HighChart Javascript library and a bit of glue logic to build my own tool to visualize the last 15 years of News!

Continue reading “15 Years of News – Analyzing CNN Transcripts: Timelines”

15 Years of News – Analyzing CNN Transcripts: Retrieving & Parsing

A while back, I saw that the Internet Archive hosted an archive of CNN transcripts from 2000 to 2012. The first thing that came to my mind was that this was an amazing corpus to study. It contained the last 12 years of news in textual form at the same place. I felt that it would be an amazing project to retrieve all the transcript from 2000 to today and someone went already to the trouble of downloading this corpus.

Unfortunately, the data was basically a dump of the transcripts pages from CNN. This isn’t a problem for archival purposes, but for analysis, it would make things a bit difficult. For my new project, it meant that I would need to find a way to download all the transcripts from CNN, parse them and dump them to a database. To make things even more difficult, the HTML from the early 2000s was more about form that function. In other words, the CNN webmasters (in the 2000, web designers or developers didn’t exist, they were webmasters!) would throw something that would render in Internet Explorer or Netscape Navigator and call it a day. There was no effort in making the layout and content organized.

Continue reading “15 Years of News – Analyzing CNN Transcripts: Retrieving & Parsing”

Thèmes abordés sur Twitter durant l’élection provinciale de 2012

Suite à la visualisation des tweets publiés durant la grève étudiante, le professeur Frédérick Bastien de l’Université de Montréal m’a approché afin de participer à l’ouvrage Les Québécois aux urnes.

Suite à la visualisation des tweets publiés durant la grève étudiante, le professeur Frédérick Bastien de l’Université de Montréal m’a approché afin de participer à l’ouvrage Les Québécois aux urnes.

J’ai donc rédigé un chapitre traitant des thèmes abordés sur les médias sociaux. L’élément central du chapitre était une visualisation de tous les tweets publiés durant la campagne électorale.

Continue reading “Thèmes abordés sur Twitter durant l’élection provinciale de 2012”

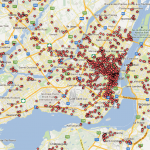

Distribution du financement politique à Montréal

Comme lors des années précédentes, La Presse a conçu une carte du financement politique à Montréal. Les responsables de ces cartes (Cédric Sam, Pierre-André Normandin et Thomas de Lorimier) ont dû composer avec l’absence de données gouvernementales standardisées et contacter chaque parti politique pour obtenir ces données.

Le résultat est très intéressant et ils font preuve d’une très grande générosité en partageant les données recueillies. Les données ouvertes comprennent la latitude et la longitude de chaque don ce qui facilite leur utilisation dans les logiciels GIS comme ArcGIS et Quantum GIS. Je me suis donc amusé ce dimanche à analyser et créer des cartes illustrant la distribution des dons. La carte à gauche illustre les concentrations de financement pour chaque parti. Par exemple, il y a une concentration de financement pour Projet Montréal sur le Plateau, Villeray et Hochelaga.

Cliquez sur le lien à droite pour lire (et voir!) la suite >>

Continue reading “Distribution du financement politique à Montréal”

Géolocalisation de #qc2012

On a beaucoup parlé des utilisateurs des médias sociaux durant la dernière campagne électorale (#qc2012 pour les intimes). Qui sont-ils? D’où viennent-ils? De quoi parlent-ils?

On a beaucoup parlé des utilisateurs des médias sociaux durant la dernière campagne électorale (#qc2012 pour les intimes). Qui sont-ils? D’où viennent-ils? De quoi parlent-ils?

Les analyses de contenu peuvent répondre à certaines de ces questions, mais pour répondre à la question « où sont-ils? », il faut soit procéder par sondage ou utiliser les données que Twitter nous offre si gentiment. Si les utilisateurs de Twitter activent la fonction de localisation, il est possible de savoir où le “twitteur” est situé. Il suffit ensuite d’importer les données dans un logiciel de visualisation géographique ou Google Tables pour obtenir une carte interactive.

Continue reading “Géolocalisation de #qc2012”

IndiceQuebec: Perception de la campagne par les médias sociaux

Avec mon collaborateur Eric Nguyen, nous avons créé une petite plateforme d’analyse des tweets politiques Québécois, soit IndiceQuebec.com Cette plateforme intercepte les micromessages contenant certains mots-clés comme #polqc ou #qc2012. Les messages sont ensuite stockés dans une base de données, puis analysés à l’aide de multiples modules. En date d’aujourd’hui, soit presque un mois après les élections, 1,5 millions de tweets sont stockés dans la base de données.

Avec mon collaborateur Eric Nguyen, nous avons créé une petite plateforme d’analyse des tweets politiques Québécois, soit IndiceQuebec.com Cette plateforme intercepte les micromessages contenant certains mots-clés comme #polqc ou #qc2012. Les messages sont ensuite stockés dans une base de données, puis analysés à l’aide de multiples modules. En date d’aujourd’hui, soit presque un mois après les élections, 1,5 millions de tweets sont stockés dans la base de données.

Le module le plus intéressant est celui analysant la teneur du message et détermine si le message est plutôt positif ou négatif. Ce module repose sur un modèle bayésien (même principe qu’un filtre de polluriels) qui détermine à l’aide d’un modèle entraîné au préalable sur un échantillon de tweets. Le modèle est ensuite appliqué sur l’ensemble des tweets au fur à mesure que les micromessages sont emmagasinés dans la base de données.

Continue reading “IndiceQuebec: Perception de la campagne par les médias sociaux”

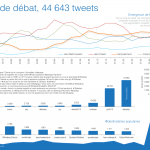

#debatQC – Analyse

Le débat des chefs durant la dernière campagne électorale était le premier débat où une quantité significative de personnes ont pu commenter le débat à l’aide des médias sociaux. En utilisant l’engin de récupération des Tweets d’IndiceQuebec, nous avons pu récupérer l’ensemble ou du moins une bonne partie des tweets politiques publiés par les Québécois actifs sur Twitter.

Le débat des chefs durant la dernière campagne électorale était le premier débat où une quantité significative de personnes ont pu commenter le débat à l’aide des médias sociaux. En utilisant l’engin de récupération des Tweets d’IndiceQuebec, nous avons pu récupérer l’ensemble ou du moins une bonne partie des tweets politiques publiés par les Québécois actifs sur Twitter.

L’image à gauche est une analyse du premier débat à Radio-Canada. La deuxième image (cliquez sur Read more) traite des faces à faces diffusées au réseau TVA.

Continue reading “#debatQC – Analyse”

Visualisation de la #GGI – Mise à jour!

Après plus de 100 jours et plusieurs centaines de milliers de tweets, le paysage médiatique et politique de la grève a bien changé. Quelques personnes sur twitter, facebook, par courriel ou de vive voix m’ont suggéré de mettre à jour la première visualisation avec des données plus récentes.

Après plus de 100 jours et plusieurs centaines de milliers de tweets, le paysage médiatique et politique de la grève a bien changé. Quelques personnes sur twitter, facebook, par courriel ou de vive voix m’ont suggéré de mettre à jour la première visualisation avec des données plus récentes.

C’est ce que j’ai fait. En cliquant sur l’image, vous devriez obtenir l’image agrandie. Sinon, en cliquant ici, vous pourrez télécharger une version vectorielle en haute-résolution.

J’ai également fait une petite étude sur l’évolution des sujets (extraits algorithmiquement) présents dans les tweets traitant de la grève. On remarque que certains sujets sont transitoires et d’autres plus permanents.

Continue reading “Visualisation de la #GGI – Mise à jour!”